deepfake:引发AI换脸技术争议

发布时间:2019-11-16 发布者:亚时财经

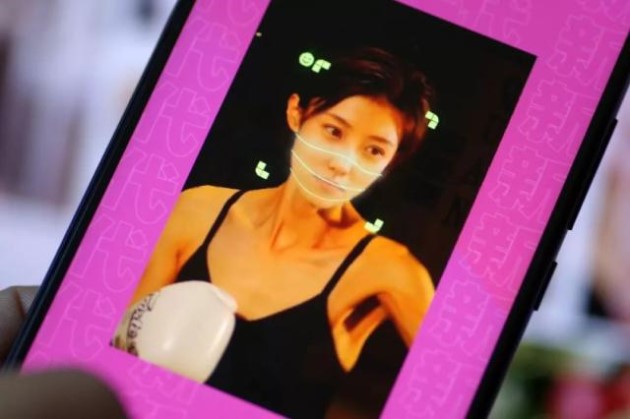

deepfake听上去或许很陌生,但如果说到它的应用——“AI换脸”,想必大家都有所了解。AI换脸技术十分弱爆,在国内外都掀起了一股浪潮。各种APP或应用让用户可以轻松用自己的脸去替换影视作品里的明星人物,从而满足自己和明星同框的愿望。

(图源:网络)

这项脑洞大开的技术在2017年由Reddit网站用户“deepfakes”提出并开源,这种源自人工智能生成对抗网络(GAN,generative adversarial network)的伪造技术,可以实现用另一张人脸图片替换掉原始视频中的原始人像。基于GAN算法的博弈优化原理,最终生成逼真度极高的伪造视频,目前已可以以假乱真。衍生出FakeApp等视频合成工具和一系列伪造影片,掀起一股“换脸”热潮。

虽然deepfake技术应用在影视文化行业的想象空间极大,但其诞生之初就伴随着肖像权、版权和伦理层面的纷争。

deepfake的滥用

近来的一项研究表明,目前网上有14678个DeepFake视频,其中96%是色情视频。大部分都是著名女演员的脸,被转移到色情明星的身体上。对于普通女性而言,deepfake技术让造假色情视频变得十分容易,基于报复或其他目的的色情视频,可能让女性面临更高的名誉风险而难以自辩。

(图源:网络)

同时,技术的革新也让“欺诈行业”不断改头换面。基于该技术的合成人像、合成语音乃至合成笔迹,让欺诈活动变得更加隐秘而难以侦查和防卫。据深科技报道,今年3月,犯罪分子成功模仿了一家英国能源公司的德国母公司CEO的声音,欺骗了多位同事和合作伙伴,一天内诈骗了220,000欧元(约合173万元人民币);新智元同样报道了一起相似案例,今年6月,间谍使用AI生成了一个并不存在的个像和资料,在职场社交平台LinkedIn上欺骗了包括政治专家和政府内部人士的众多联系人。

除此之外,deepfake的潜在效应还将蔓延到大众的信息获取和社会信任层面。外交政策研究所研究员Clint Watts表示,“如果一个消费者不能从虚构中辨别事实,那么他们要么相信一切,要么什么都不相信。”

应对方法

纽约州立大学教授Siwei Lyu和学生发现,使用AI技术生成的假脸极少甚至不会眨眼,因为它们都是使用睁眼的照片进行训练的。据此,美国国防部研究机构DAPRA研发出了首款「反变脸」的AI刑侦检测工具。但他们同时也表示,随着鉴别技术的提升,假视频的质量也会进一步提高。而且“打假”与“造假”的规模不成比例,关于“打假”的研究寥寥无几。因此他们觉得这项AI刑侦技术可能很快就没用了。

AI换脸几乎不能眨眼 (图源:网络)

除了AI对抗AI以外,还有一些其他途径可以应对。一些企业选择合理释放技术成果,比如只公布简化版本而保留一些核心内容,这样可以避免技术被人恶意利用。还可以将自动检测工具与人工审查相结合,更好地对相关内容进行审查取证。立法监管也是一个正在尝试的应对方法,从法律层面约束这类技术,防止滥用。

还可以从用户群体方面来入手,提高人们的安全意识与权益意识,防止自身利益受到损害或损害他人利益。就像之前火热的中国换脸APP“ZAO”,一经推出便在朋友圈掀起换脸狂潮,大家纷纷在各种社交平台分享自己的换脸视频。然而,有法律专业人士提出,该产品涉及侵犯著作权、肖像权、隐私权等诸多法律问题,并指出该APP相关条例中的“霸王条款”:用户只要同意条款,就意味着允许ZAO使用用户的肖像及相关内容,间接让用户同意ZAO收集自己的肖像信息。这种情况一旦ZAO出现数据库泄露等情况,那用户的相关利益可能受到极大损失。

亚洲时报 综合

责任编辑:杨志杰

特别声明:本站转载或引用之图文若侵犯了您的合法权益,请与本站联系,本站将及时更正、删除。版权问题及网站合作,请通过亚时财经邮箱联系:asiatimescn@sina.com热门话题更多>>

国务院国资委网站3月31日发布消息,经报国务院批..[查看详细]

2021-04-01 10:43

3月份中国制造业采购经理指数、非制造业商务活动指..[查看详细]

2021-03-31 10:20

联合国粮农组织公布的数据显示,2021年2月份,..[查看详细]

2021-03-25 15:22

3月22日,中国电子信息产业发展研究院发布的《2..[查看详细]

2021-03-22 16:53

风电板块走强,节能风电拉升涨停,大金重工涨超6%..[查看详细]

2021-03-19 10:47

3月18日,国家互联网信息办公室、公安部加强对语..[查看详细]

2021-03-18 19:36

1-2月份,在以习近平同志为核心的党中央坚强领导..[查看详细]

2021-03-15 14:41

3月11日,国务院总理李克强在人民大会堂三楼金色..[查看详细]

2021-03-12 10:00

今日,核电板块走强,整个指数大涨4%。截至发稿,..[查看详细]

2021-03-08 15:11

今天上午,十三届全国人大四次会议在人民大会堂开幕..[查看详细]

2021-03-05 15:06